Появилась модель, способная создавать реалистичную анимацию говорящих лиц

В последние годы компьютерная анимация активно развивается, но до сих пор было весьма проблематично создать анимацию лица персонажа во время его разговора, так как это требует сложного сочетания аудио и видеоэлементов. Новая модель, представленная на Индийской конференции по компьютерному зрению, графике и обработке изображений, может быть активно использована в будущем для создания более качественных анимационных фильмов.

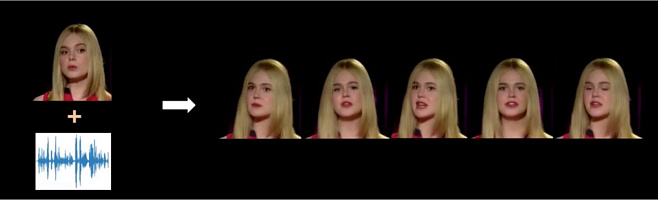

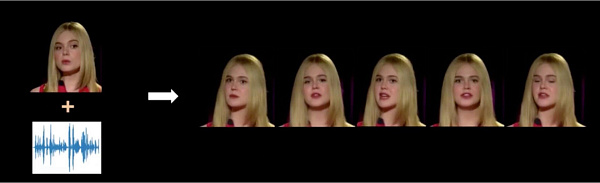

Большинство современных методов создания анимации лица говорящего персонажа были сосредоточены на синхронизации межу самой речью и движениями губ. Однако очень важно сохранить и естественное моргание глаз, и движения головы. Прошлые работы исследователей доказали, что существует взаимосвязь между движениями головы, выполняемыми дикторами, и высотой и амплитудой их голоса. Эти заключения вдохновили исследователей на разработку нового метода анимации, при котором создаются движения головы для анимации лица, которые отражают голос персонажа и содержание его речи.«Мы разработали полный конвейер реалистичной лицевой анимации, управляемой речью, который генерирует видео говорящих лиц с точной синхронизацией губ, естественным морганием глаз и реалистичным движением головы. Мы изучаем движение, вызванное речью, по лицевым ориентирам и используем эти ориентиры для создания текстуры кадров анимационного видео», – отметила команда исследователей.Новая модель основана на GANs классе алгоритмов машинного обучения. Модель определяет, о чем говорит человек, интонацию его голоса в определенные временные промежутки. Затем она использует эту информацию для создания соответствующих и коррелирующих движений головы. В следующих исследованиях команда планирует дальше работать над реалистичной лицевой экспрессией.

Фото: Biswas

Технологии

Ксения Кулько

Ученые проанализировали, как люди воспринимают пограничные стены, разделяющие государства

Ученые проанализировали, как люди воспринимают пограничные стены, разделяющие государства  Вулканическое озеро в Коста-Рике показывает, где на Марсе могла существовать жизнь

Вулканическое озеро в Коста-Рике показывает, где на Марсе могла существовать жизнь