Тема «восстания машин» популярна в научной фантастике, и многие эксперты в мире считают, что эти страхи имеют под собой реальное основание в развитии «сильного» искусственного интеллекта, благодаря которому роботы научатся ценить своё существование как важное для выполнения возложенных на него человеком задач. Таким образом, прежде бездушные механизмы получать нечто похожее на биологический инстинкт к самосохранению, который при определённых условиях может вызвать отношение к человеку как к угрозе и соответственно к ответным агрессивным мерам.

— Любое внедрение в нашу жизнь революционных технологий, в том числе робототехнических, сопровождается конфликтами между различными группами людей. Вспомним, например, движение луддитов в XIX веке. Эти конфликты не зависят от уровня интеллекта роботов. Пока роботы оснащены относительно низким уровнем интеллекта, суть конфликтов будет определяться возможным различием интересов, в частности, владельцев обслуживающих роботов и пользователей. Опасность конфликтов человек — робот будет возрастать при внедрении в роботов инстинкта самосохранения и, что ещё более важно, возможности их самоидентификации, появлению собственных мотиваций, — отмечает эксперт.

Хотя переход к «сильному» ИИ — это ещё достаточно отдалённая перспектива, но уже сейчас искусственный интеллект роботов может идти наперекор интересам конкретного человека или группы людей.

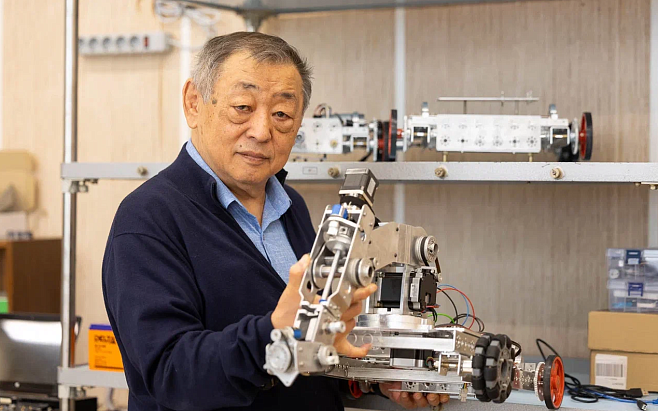

— На самом деле даже обычные роботы, которые есть сейчас, например, роботы-водители беспилотных автомобилей, уже имеют заложенные разработчиком предпочтения. И эти заложенные предпочтения, например, получение максимальной выручки с клиента, могут идти вразрез с нашими предпочтениями. Здесь и проявляется конфликт «робот — человек», потому что робот будет выполнять функции, в которых заложено получение максимальной прибыли, а пассажир, который садится в это беспилотное такси, будет заинтересован в получении чека на минимальную сумму. Как этот конфликт будет разрешаться? Пока мы не знаем, но вполне возможно, что робот переубедит пассажира в том, что он более прав. Такие конфликты с развитием искусственного интеллекта будут нарастать в самых разных сферах его применения, — считает Николай Ким.

Такого рода риски особенно высоки в среде коллаборативных роботов — роботов, которые могут работать в непосредственном контакте с человеком. Именно в них прежде всего будут закладываться функции самостоятельного принятия решений, а их деятельность будет непосредственно сказываться на человеке.

Но можем ли мы предотвратить риски, проистекающие от слишком умных и самостоятельных роботов? В определённой степени можем, считает эксперт, если законодательно регулировать степень применения искусственного интеллекта. Когда изобрели автомобили, законодательство всех стран мира ввело ограничения на скоростной режим при их использовании. Когда появилась авиация, ввели воздушные коридоры, чтобы самолёты не сталкивались друг с другом во время полёта. Точно также и в робототехнике: с развитием техники с искусственным интеллектом необходимо вводить определённые ограничительные стандарты.

— Сейчас такие стандарты введены в коллаборативной робототехнике, например, на недопустимость соприкосновения с определёнными скоростями в рамках столкновений с человеком. Однако подобные меры не могут полностью исключить риски с развитием искусственного интеллекта, особенно в отношении отдельных компаний или разработчиков. Трудно абсолютно всех игроков заставить делать то, что договорились делать во всём мире, не повысить уровень интеллекта до слишком высокого уровня — отмечает эксперт.

Однако стратегической проблемой развития и широкого внедрения робототехники и искусственного интеллекта остаётся сложность долгосрочного прогнозирования возможных, в т.ч. глобальных, последствий этих технологий. Человечество только учится пользоваться новыми возможностями и будем надеяться, что ошибки в этой учёбе мы пройдём с минимальными потерями. Так что риски в любом случае остаются, — отмечает Николай Ким.

Фото: пресс-служба МАИ